Meta提交的一项新专利显示,它可以用于视频游戏和

VR应用带来更逼真的嘴部同步和面部动画技术。由这些更真实的面部运动创造出来。

并为玩家的头像提供更真实、更身临其境的体验,包括

在虚拟现实游戏中。

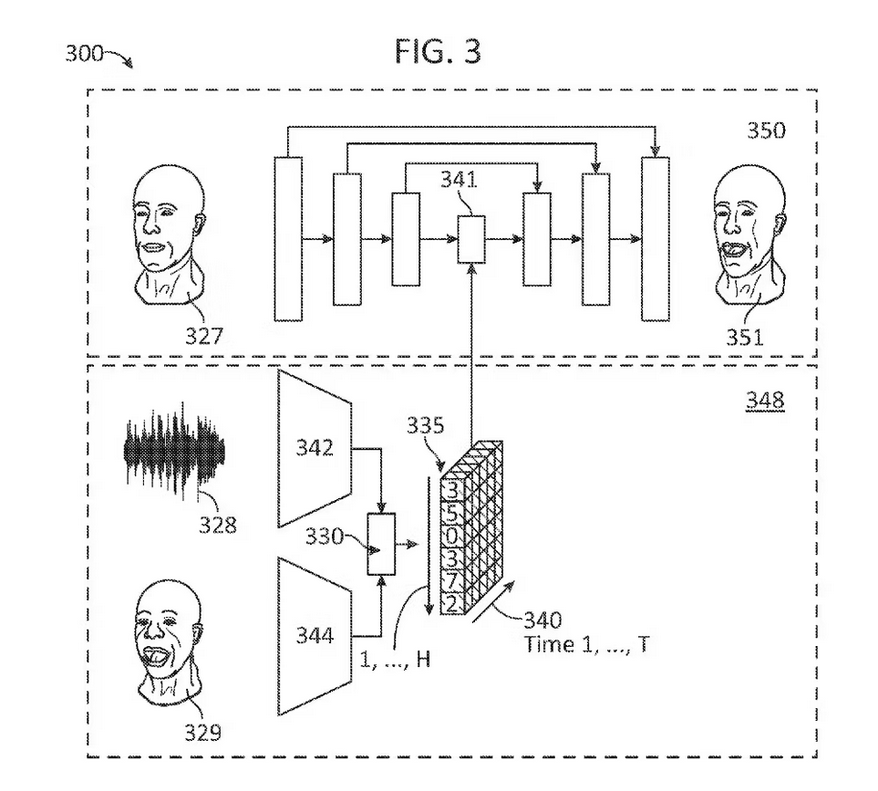

这项专利详细介绍了将用户的语音转换为逼真的嘴部同步和面部动画的各种方法,以便开发者可以灵活选择使用这一系统的方式。该专利中概述的一种方法涉及使用多人阅读

50个不同语音平衡句子的音频和视频记录的数据集,系统在他们阅读每个句子时跟踪他们的面部表情。通过跟踪个人在阅读每一句话时的面部和嘴部如何移动,系统可以提取和混合这些动作,使角色的动画更加逼真,甚至包括眨眼和眉毛等细微的动作。

除了能够基于现有数据集生成面部动画和嘴部同步,这项专利还描述了该系统如何使用集成到

VR头戴式耳机中的摄像头来做同样的事情。此功能允许您

VR用户拥有可以准确模仿其面部表情的头像,从而在多人游戏和《VRchat》等社交VR体验中获得更真实的沉浸式体验。